Habilite una transparencia 5 veces mayor en AIOps, logrando un resultado comercial más confiable y preciso

Los proveedores de servicios en la vertical de conectividad adoptan la Inteligencia Artificial para Operaciones de TI (AIOps) para transformar sus negocios, pero los usuarios dudan en confiar sus operaciones a una plataforma compleja que no proporciona claridad ni visibilidad de su funcionalidad. Debido a la falta de transparencia, los proveedores de servicios están preocupados por tomar malas decisiones basadas en recomendaciones de IA y la responsabilidad de tales decisiones y acciones.

En su búsqueda de operaciones autónomas, los proveedores de servicios buscan ser más proactivos con análisis predictivos, donde las máquinas toman la mayoría de las decisiones y ayudan a los ingenieros a tomar acciones preventivas. Sin embargo, los ingenieros deben tener una visibilidad completa de la lógica subyacente utilizada por los AIOps y la capacidad de validar si el resultado es confiable.

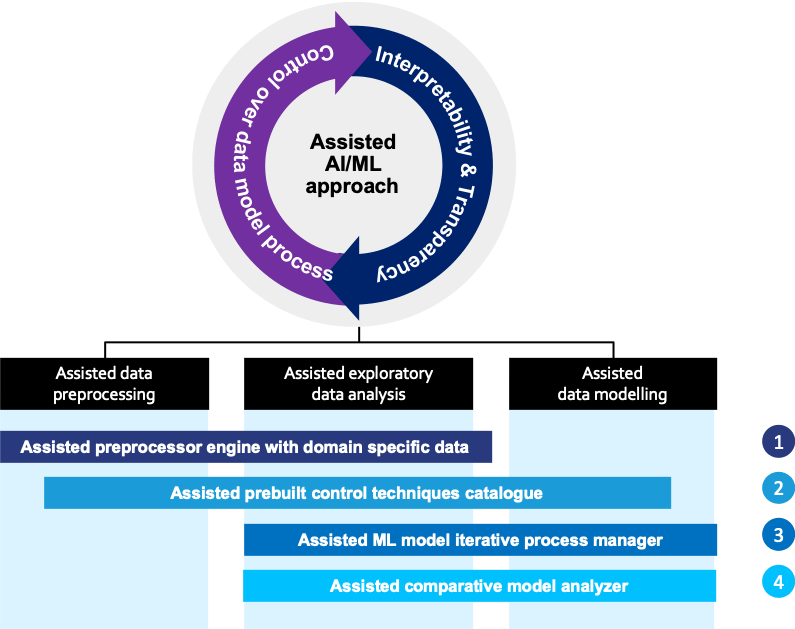

Figure1: Estructura de aprendizaje automático e inteligencia artificial asistida

Para acelerar el desarrollo de modelos de IA/ML con mayor transparencia, las empresas deben pasar del aprendizaje automático existente a soluciones asistidas basadas en estructuras de IA/ML.

Los modelos explicables de aprendizaje automático (ML) tienen como objetivo resolver este problema explicando la lógica de las soluciones AIOps para que los usuarios puedan comprender fácilmente el resultado. El modelo explica la aplicación de la solución de IA y su resultado a los usuarios de una manera que puedan comprender claramente el resultado, confiar en él y confiar en él. La explicación en el modelo ML puede verse como un medio para transformar un AIOps de caja negra en un AIOps de caja de vidrio, levantando con precisión el velo sobre su computación y lógica.